Durante los últimos años, la inteligencia artificial ha sido presentada como una fuerza capaz de transformar cualquier empresa de forma casi inmediata. Presentaciones brillantes, titulares grandilocuentes y demostraciones espectaculares han alimentado una narrativa de urgencia constante: quien no adopte IA ahora quedará irremediablemente atrás. Este fenómeno no es casual ni nuevo: responde a dinámicas de expectativa inflada que ya hemos analizado en detalle al hablar de la posible burbuja de la IA en el contexto empresarial.

Sin embargo, cuando se observa con atención cómo las organizaciones están usando realmente estas tecnologías en su día a día, la realidad del uso empresarial de la IA resulta mucho más matizada, pragmática y, en muchos casos, menos espectacular de lo prometido.

Este análisis no parte de promesas futuristas ni de discursos de marketing. Se apoya en patrones observables, implementaciones reales y límites técnicos actuales, siguiendo el enfoque editorial de Threshold Review: examinar la tecnología con rigor, contexto y una mirada crítica orientada a su impacto práctico en organizaciones reales. Puedes conocer más sobre cómo abordamos este tipo de análisis en nuestra metodología editorial.

Qué muestra este análisis

- Dónde la IA está aportando valor real hoy (sin necesidad de “reinventar” la empresa).

- Qué usos se repiten cuando se busca eficiencia operativa y reducción de fricción.

- Qué límites siguen siendo estructurales y por qué algunos enfoques fallan de forma predecible.

- Qué patrones comparten las empresas que sí obtienen resultados sin perder control ni criterio.

Automatización de tareas internas y soporte operativo

El uso más extendido y consistente de la inteligencia artificial en empresas hoy es la automatización de tareas internas repetitivas. Sistemas basados en IA se emplean para responder preguntas frecuentes, clasificar incidencias, enrutar solicitudes internas o generar borradores de documentación operativa. No sustituyen equipos completos, pero reducen fricción, aceleran tiempos de respuesta y liberan capacidad humana para tareas de mayor valor.

Micro-escena: un equipo interno recibe decenas de consultas al día (“¿cómo pido vacaciones?”, “¿dónde está este documento?”, “¿quién aprueba este gasto?”). Un asistente bien acotado responde lo básico y deriva los casos dudosos a una persona. No “revoluciona” la empresa: evita que lo sencillo consuma el tiempo de siempre.

En estos contextos, la IA funciona bien porque opera dentro de límites claros. Se le asignan problemas acotados, con entradas relativamente estructuradas y resultados fácilmente verificables por personas. Cuando falla, el impacto es controlable, y cuando acierta, el beneficio se acumula de forma silenciosa pero sostenida.

Cuándo funciona (y cuándo no)

Funciona cuando el caso de uso está acotado, el contenido de entrada es razonablemente estable y existe revisión humana para errores y excepciones.

Falla cuando se pretende que la IA “atienda” situaciones ambiguas sin criterios claros, sin canal de escalado o sin responsables de calidad y actualización.

Análisis de datos y reporting asistido

Otro ámbito donde la IA está aportando valor tangible es el análisis de datos asistido. Muchas organizaciones utilizan modelos para resumir grandes volúmenes de información, detectar tendencias preliminares o generar informes iniciales a partir de datos internos. En lugar de reemplazar al analista, estos sistemas actúan como una capa de apoyo que acelera el trabajo y reduce la carga cognitiva inicial.

Micro-escena: una dirección pide “qué ha pasado este mes” con ventas, soporte y devoluciones. La IA arma un primer resumen, agrupa incidencias recurrentes y sugiere 3 hipótesis. El responsable valida con datos, corrige lo que no cuadra y decide qué mirar. El valor no está en “adivinar”: está en empezar la conversación con un mapa.

Las implementaciones más eficaces no delegan decisiones críticas en la IA. La utilizan como herramienta de exploración y apoyo, manteniendo siempre supervisión humana sobre conclusiones, interpretaciones y acciones finales. Cuando se respeta este equilibrio, la IA mejora la velocidad y la claridad sin introducir riesgos innecesarios.

Cuándo funciona (y cuándo no)

Funciona cuando se usa como soporte para explorar hipótesis, resumir y priorizar información, y el humano conserva el cierre de interpretación y decisión.

Falla cuando el output se trata como “verdad” sin contraste, o cuando se usa para justificar conclusiones que nadie puede explicar ni auditar.

Generación de contenido empresarial con IA asistida

La generación de contenido es uno de los usos más visibles de la IA en el entorno empresarial, pero también uno de los más malinterpretados. En la práctica, las empresas que obtienen resultados consistentes no utilizan estos sistemas para producir contenido final sin control, sino como herramientas de apoyo para acelerar borradores, estructurar información o desbloquear procesos creativos y documentales.

La IA se emplea para redactar primeras versiones de informes, propuestas internas, documentación técnica o comunicaciones recurrentes, siempre bajo supervisión humana. El valor no está en la creatividad autónoma, sino en la reducción del tiempo necesario para pasar de una idea inicial a un texto trabajable. Cuando se elimina la revisión humana, la calidad y la coherencia suelen deteriorarse rápidamente.

Este patrón refleja una constante en el uso empresarial de la IA: funciona mejor como amplificador de capacidades existentes que como sustituto completo del criterio profesional. Las organizaciones que lo entienden así evitan errores reputacionales y mantienen control sobre el mensaje, el contexto y las implicaciones legales del contenido generado.

En la práctica, el riesgo no es “usar IA”. El riesgo es publicar o enviar comunicaciones sin responsable claro, sin fuentes verificables y sin una última lectura humana que se haga cargo del contenido.

Detección de patrones, riesgos y anomalías con IA

Uno de los usos más sólidos y menos visibles de la inteligencia artificial en empresas es la detección temprana de patrones anómalos. Sistemas de IA se utilizan para identificar desviaciones en datos financieros, comportamientos inusuales en sistemas operativos, posibles fraudes o fallos incipientes en infraestructuras técnicas antes de que se conviertan en incidentes graves.

En estos casos, la IA no toma decisiones finales ni ejecuta acciones por sí misma. Su función es señalar lo que merece atención humana. Al reducir el ruido y destacar lo relevante, estos sistemas permiten que equipos especializados actúen con mayor rapidez y precisión, especialmente en entornos donde el volumen de datos supera la capacidad de análisis manual.

Las implementaciones más maduras integran estos modelos dentro de procesos de supervisión claros, con responsables definidos y protocolos de actuación bien establecidos. Cuando la detección automática se combina con gobernanza y responsabilidad humana, la IA se convierte en una herramienta fiable para reducir riesgos operativos y mejorar la resiliencia organizativa. Y, en pymes, este tipo de usos conecta con una realidad más amplia: la seguridad solo se vuelve “tema” cuando la complejidad del sistema supera la capacidad de control. Si quieres situarlo sin alarmismo, aquí tienes el marco: Ciberseguridad en pymes: cuándo es un problema real y cuándo no.

Cuándo funciona (y cuándo no)

Funciona cuando el objetivo es reducir ruido y priorizar señales, con equipos y protocolos listos para investigar y decidir.

Falla cuando se convierte en un sistema de “alarma constante” sin umbrales, sin responsables y sin capacidad de respuesta humana, generando fatiga y desconfianza.

Optimización de procesos empresariales con IA

Más allá de tareas individuales, algunas empresas están utilizando la inteligencia artificial para optimizar procesos completos, siempre que estos estén bien definidos y acotados. Esto incluye desde la priorización automática de solicitudes hasta la asignación de recursos en función de reglas claras y datos históricos. El objetivo no es automatizar la estrategia, sino reducir fricciones operativas en decisiones repetitivas.

Estos sistemas funcionan cuando los márgenes de decisión están claramente delimitados y los criterios de éxito son medibles. La IA puede sugerir, priorizar o recomendar, pero las decisiones finales permanecen bajo control humano. Cuando se intenta extender este enfoque a procesos ambiguos o altamente contextuales, los resultados tienden a ser inconsistentes.

Las organizaciones que obtienen valor real entienden que la optimización con IA no consiste en delegar el control, sino en mejorar la eficiencia de flujos existentes. La tecnología actúa como una capa de soporte que reduce tiempos, errores y cargas innecesarias, sin erosionar la responsabilidad ni la capacidad de intervención humana.

En este contexto, algunas empresas optan por plataformas que integran CRM, automatización e inteligencia artificial en un mismo sistema, con la expectativa de optimizar procesos completos de forma más rápida.

Un ejemplo habitual es HubSpot: una plataforma que incorpora IA como capa de apoyo dentro de procesos comerciales y de marketing, pero cuyo valor real depende mucho del grado de madurez operativa de la empresa y de la claridad de sus flujos internos. Cuando se adopta sin esa base, la complejidad añadida puede superar al beneficio esperado.

Si quieres entender cuándo este tipo de plataformas tiene sentido en una pyme y cuándo introduce más fricción que valor, lo analizamos en detalle aquí:

HubSpot para pymes: cuándo sí y cuándo no

Cuándo funciona (y cuándo no)

Funciona cuando el proceso está definido, los criterios de priorización son explícitos y hay mecanismos para corregir sesgos, errores y cambios del entorno.

Falla cuando se intenta optimizar lo que no está claro, cuando el equipo no entiende el “por qué” de las recomendaciones o cuando se automatizan decisiones sin responsables.

Lo que no está funcionando (todavía)

No todos los intentos de adopción de inteligencia artificial en empresas están dando resultados positivos. De hecho, muchos de los fracasos comparten patrones claros que se repiten con independencia del sector o del tamaño de la organización. Identificarlos es clave para evitar expectativas infladas y decisiones mal orientadas.

Reemplazo total de funciones humanas complejas

Uno de los errores más comunes es intentar sustituir completamente funciones que requieren juicio, contexto y comprensión profunda del entorno. Cuando se espera que la IA tome decisiones complejas de forma autónoma, sin supervisión ni capacidad de corrección humana, los resultados suelen ser erráticos y difíciles de justificar.

Estos sistemas no fallan por falta de potencia, sino por una comprensión incorrecta de lo que pueden —y no pueden— hacer. El problema no es técnico, sino de enfoque.

Sistemas sin gobernanza ni responsabilidad clara

La falta de marcos de gobernanza es otro punto crítico. Implementar IA sin definir quién es responsable de sus resultados, cómo se auditan sus decisiones o cuándo debe intervenir una persona genera riesgos operativos y organizativos. Sin responsabilidad clara, incluso los sistemas técnicamente correctos pueden convertirse en un problema.

Anti-ejemplo típico: “ponemos un chatbot” y nadie es dueño del contenido. A los dos meses responde con información vieja, nadie actualiza nada y el equipo acaba desactivándolo por vergüenza (o lo deja vivo y se convierte en riesgo).

Expectativas infladas y métricas equivocadas

Muchas iniciativas fracasan porque se miden con indicadores inadecuados. Esperar retornos inmediatos o evaluar la IA únicamente por ahorro de costes ignora beneficios más sutiles como reducción de errores, mejora en tiempos de respuesta o mayor claridad operativa.

Cuando las métricas no reflejan el valor real, la percepción del fracaso suele llegar antes que los resultados.

IA como sustituto del pensamiento estratégico

Algunos proyectos fallan al utilizar la IA como reemplazo del pensamiento estratégico en lugar de como apoyo. Ningún sistema actual puede definir objetivos empresariales, interpretar cambios estructurales del mercado o asumir responsabilidades directivas.

Cuando se delega este tipo de decisiones, la organización pierde criterio en lugar de ganarlo.

Patrones de éxito en la implementación de IA empresarial

Cuando se analizan las organizaciones que están obteniendo resultados sostenidos con inteligencia artificial, aparecen patrones comunes que van más allá de la tecnología utilizada. No se trata de disponer de los modelos más avanzados, sino de cómo se integran en la estructura operativa y cultural de la empresa.

Las empresas que lo están haciendo bien suelen empezar con casos de uso pequeños y concretos, evitando despliegues masivos sin validación previa. Este enfoque conecta con una lógica que aplicamos de forma transversal en Threshold Review: definir primero el problema antes de elegir la solución. Es el mismo principio que desarrollamos en nuestra guía Cómo elegir software para tu pyme sin equivocarte.

En muchos de estos casos, el valor no viene de la inteligencia artificial en sí, sino de tener procesos bien definidos sobre los que aplicarla. Sin una base sólida, la IA no amplifica capacidades: amplifica el desorden.

De hecho, en pymes suele ser más efectivo empezar por automatizar partes concretas del proceso comercial antes de introducir capas de inteligencia artificial. Hemos analizado este enfoque en detalle en Cómo automatizar ventas en una pyme sin equipo técnico, donde el foco está en reducir fricción antes de añadir complejidad.

Otro rasgo compartido es la claridad en la responsabilidad y en los límites del sistema. Estas organizaciones saben quién responde por cada herramienta, cuándo debe intervenir una persona y qué decisiones no deben automatizarse. Esta misma lógica aplica al uso de software empresarial en general, especialmente en áreas críticas como la gestión de clientes, donde perseguir soluciones “perfectas” suele ser un error estructural, como explicamos en El «mejor CRM para pymes» no existe.

Y cuando la IA entra en herramientas empresariales que tocan decisiones, datos sensibles o cumplimiento normativo, conviene entender qué cambia de verdad la regulación para pymes (y qué no) para no adoptar “a ciegas” por miedo. Lo aterrizamos aquí: AI Act en pymes: qué decisiones SÍ cambia y cuáles NO.

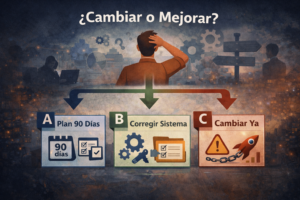

Si eres pyme: 3 usos seguros para empezar (y 3 usos a evitar)

3 usos seguros (bajo riesgo, alto retorno)

- Borradores internos y documentación: actas, procedimientos, emails repetitivos (siempre con revisión humana).

- Soporte interno acotado: FAQs, onboarding, consultas recurrentes con canal de escalado.

- Resúmenes y priorización: “qué ha pasado” en ventas/soporte/proyectos para empezar a investigar, no para decidir.

3 usos a evitar (por ahora) si no tienes base

- Publicación “en automático” de contenido externo o comunicación sensible sin responsable editorial.

- Decisiones comerciales críticas (pricing, aprobación, descuentos, riesgo) delegadas en la IA sin gobernanza.

- Chatbots cara al cliente sin umbrales, sin mantenimiento y sin un humano que “responda de verdad”.

Conclusión: menos promesas, más criterio

El uso empresarial de la IA en 2025 está lejos de las narrativas de sustitución total y automatización sin fricción que dominaron el discurso inicial. En la práctica, las implementaciones más exitosas son discretas, específicas y profundamente humanas en su diseño.

La inteligencia artificial funciona cuando amplifica capacidades existentes, no cuando intenta reemplazarlas. Aporta valor cuando se integra con procesos claros, responsabilidades definidas y supervisión humana real.

Las empresas que extraen valor sostenido no persiguen el último avance tecnológico por sí mismo. Se centran en resolver problemas concretos, medir impactos reales y mantener siempre el control sobre las decisiones críticas.

La IA no está cambiando quién decide en las empresas.

Está dejando en evidencia quién nunca tuvo claro cómo decidía.

En Threshold Review analizamos estas dinámicas desde una perspectiva crítica y basada en casos reales, alejándonos del hype y las simplificaciones excesivas. Si quieres entender cómo evaluamos tanto IA como software empresarial sin sesgos comerciales, puedes consultar nuestra metodología de análisis y nuestra política editorial.